ChatterUI アプリ

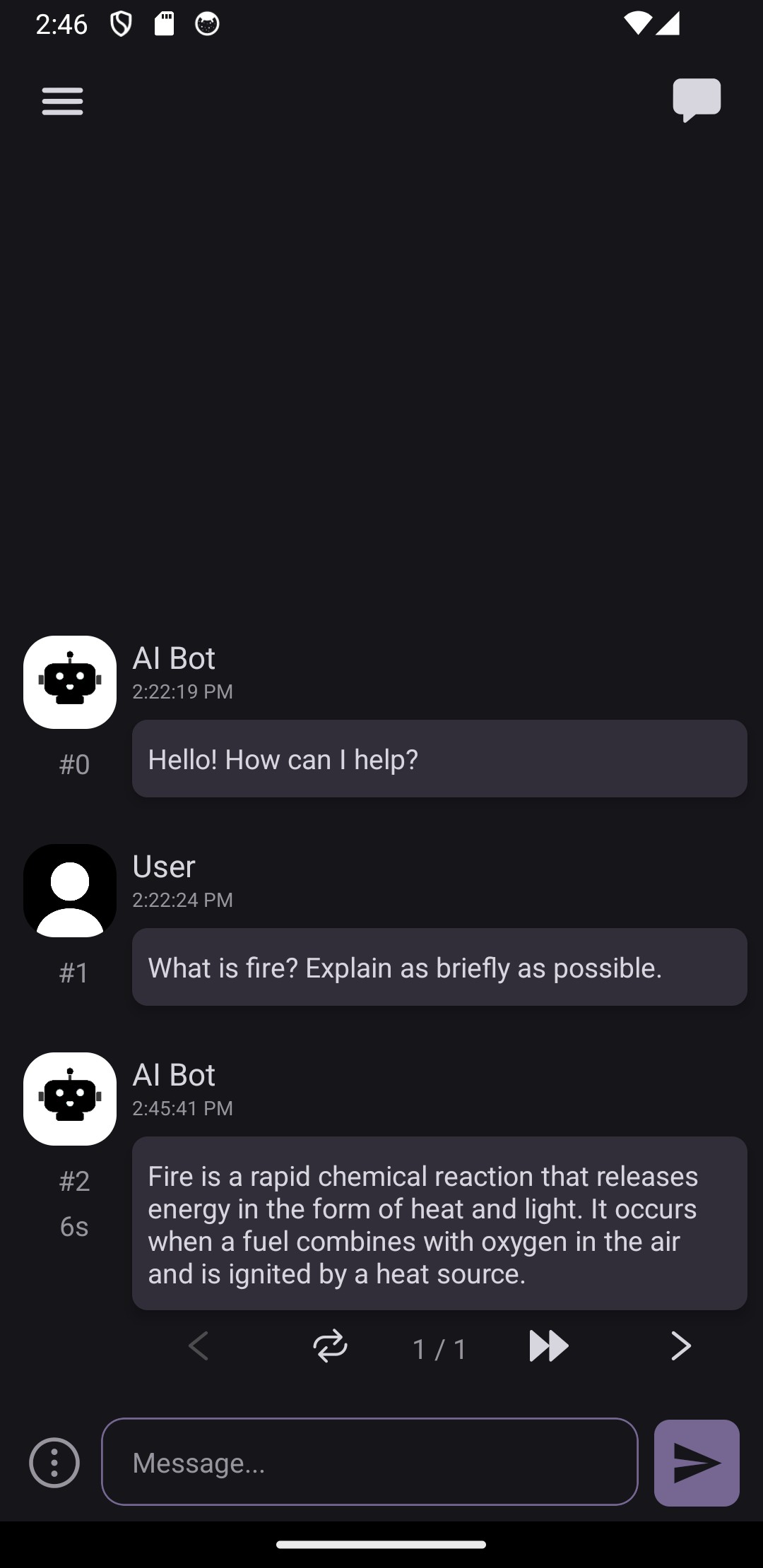

デバイス上でLLMを実行するか、さまざまな商用またはオープンソースのAPIに接続します。ChatterUIは、チャット構造を細かく制御できるモバイルフレンドリーなインターフェースを提供することを目指しています。特徴:

デバイス上でLLMをローカルモードで実行

リモートモードでさまざまなAPIに接続

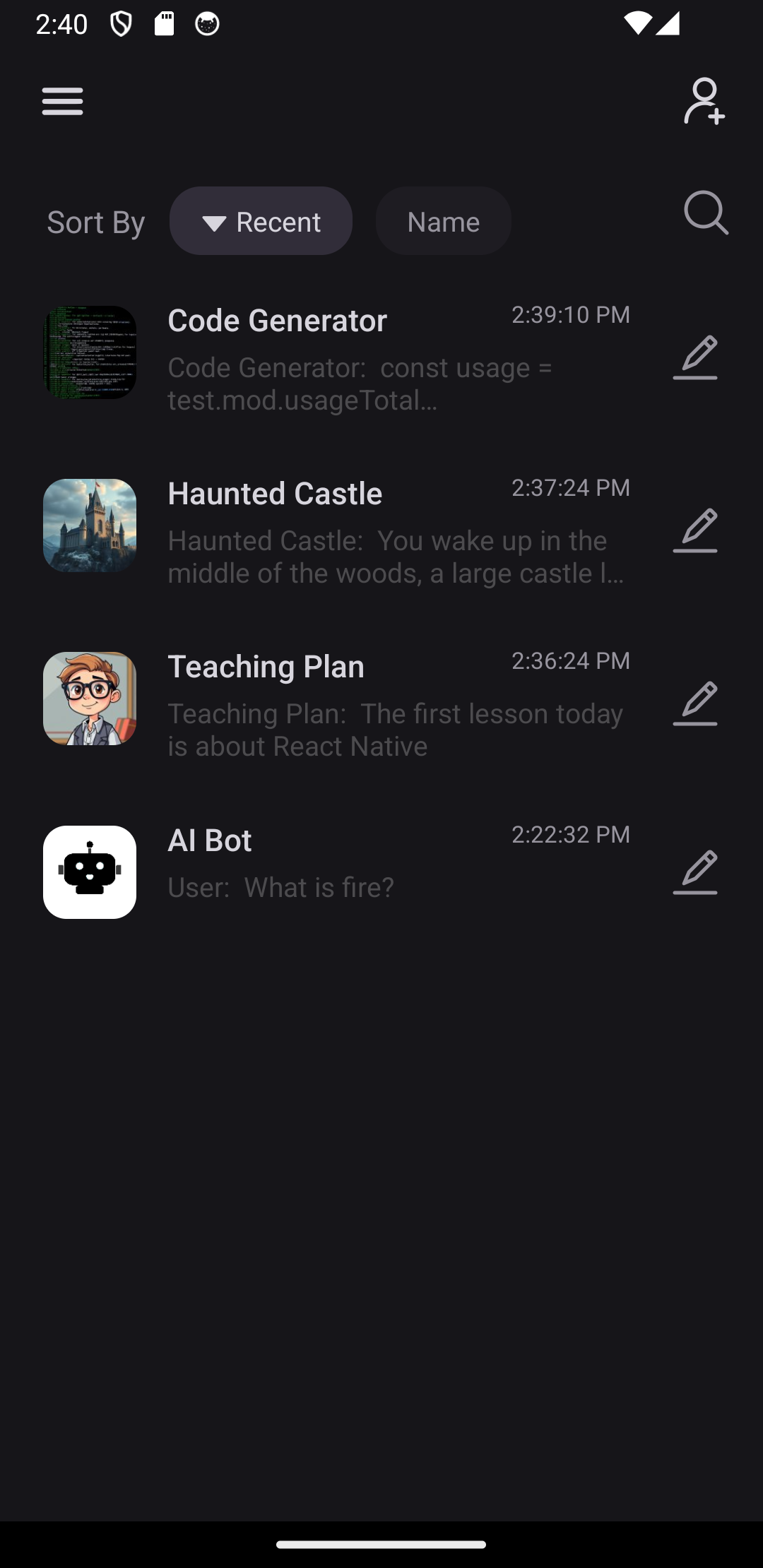

キャラクターとのチャット。(Character Card v2仕様をサポート。)

キャラクターごとに複数のチャットを作成および管理

サンプラーフィールドとインストラクションフォーマットをカスタマイズ

デバイスのテキスト読み上げ(TTS)エンジンと統合

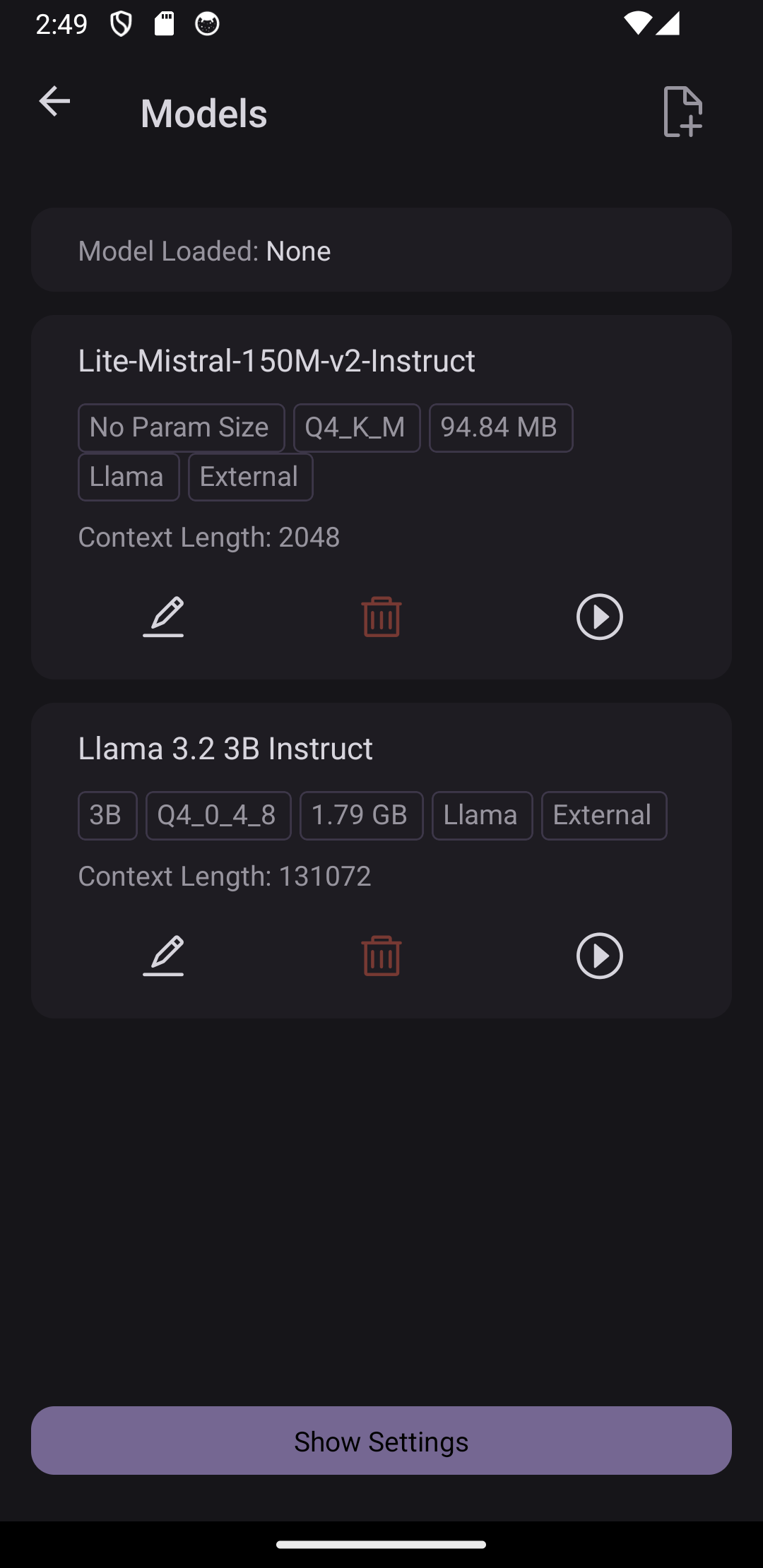

デバイス上での推論を使用するには、まずローカルモードを有効にし、次に「Models > Import Model / Use External Model」に進み、デバイスのメモリに合うggufモデルを選択します。インポート機能は以下の通りです:

Import Model: モデルファイルをChatterUIにコピーし、起動時間を短縮する可能性があります。

Use External Model: デバイスストレージから直接モデルを使用し、大きなファイルをChatterUIにコピーする必要がなくなりますが、読み込み時間にわずかな遅延が生じます。

その後、モデルを読み込み、チャットを開始できます!

注意:Snapdragon 8 Gen 1以上またはExynos 2200+を搭載したデバイスでは、最適化されたパフォーマンスのためにQ4_0量子化を使用することをお勧めします。

リモートモードでは、商用およびオープンソースプロジェクトの一般的なAPIに接続できます。